Lorem ipsum dolor sit amet, consectetur adipiscing elit

Acompanhe

Desde o lançamento do ChatGPT, a inteligência artificial (IA) saiu da bolha da tecnologia e entrou no debate público. As vantagens e desvantagens do seu uso são o principal tema da discussão.

Para você entender alguns dos tópicos do debate, separamos 6 vantagens e 6 desvantagens da inteligência artificial. Continue a leitura para conhecer as desvantagens. Para conhecer as vantagens,

leia este artigo.

A primeira desvantagem da inteligência artificial que nos vem à menta é a substituição ou redução do papel do ser humano em atividades laborais. Em outras palavras, a IA pode causar desemprego em massa ou precarização das condições de trabalho para alguns profissionais que podem ser substituídos por máquinas.

Relatório do Goldman Sachs de março de 2023 estima que 300 milhões de postos de emprego em tempo integral estão em risco com a IA generativa. Isso significa que parte da carga de trabalho já pode ser automatizada ou, dependendo da função exercida, mais da metade das atividades pode ser feita pela IA. Para os autores do estudo, funcionários administrativos e advogados são as categorias profissionais que verão mais atividades sendo automatizadas.

Outro estudo,

feito pela OCDE e divulgado em julho de 2023, estima que um quarto dos empregos nos países que fazem parte da organização internacional já pode ser completamente automatizado.

A hipótese de que a IA vai substituir o trabalho humano levou o historiador e professor convidado da Pós PUCPR Digital ,

Yuval Noah Harari , a prever o surgimento de uma “classe de inúteis” até 2050. Seria um grupo de pessoas desempregadas que não conseguiria se recolocar no mercado de trabalho, por não dominarem o uso das tecnologias.

Devido a cenários como esse, entidades como a OCDE e a ONU orientam que governos transformem a alfabetização digital e a capacitação dos trabalhadores em política pública.

Em artigo para o site especializado em tecnologia Gizmodo, Yingying Lu, pesquisadora do Centre for Applied Macroeconomic Analysis (CAMA) da Crawford School of Public Policy, resumiu o debate entre economistas sobre como a inteligência artificial pode deixar a sociedade mais desigual.

A autora explica que automação de atividades vai aumentar ainda mais a vantagem do capital sobre o trabalho, o que enfraquece instituições laborais – como sindicatos, negociações coletivas e regulamentação governamental.

Ao mesmo tempo, haverá uma redução na arrecadação de governos via tributos, o que diminui a capacidade do Estado de manter e ampliar programas de redistribuição de renda.

Trabalhadores que realizam funções que não exigem treinamento ou experiência verão os salários diminuírem, o que vai aprofundar as desigualdades dentro de uma sociedade.

Do ponto de vista da economia global, a produtividade induzida pela IA deve redistribuir empregos entre os países e reestruturar trocas comerciais, aumentando as diferenças socioeconômicas entre nações desenvolvidas e em desenvolvimento. Já existe uma cisão entre países que pesquisam e desenvolvem ferramentas de inteligência artificial, como Estados Unidos e China, e os que adquirem essas tecnologias, em menor ou maior escala.

A IA pode gerar viés ou discriminação algorítmica contra grupos minoritários ou vulneráveis, devido as bases de dados pré-concebidas com informações desatualizadas, valores ou padrões hegemônicos.

E essa discriminação já acontece: em 2018, a Amazon descartou o algoritmo que desenvolveu para seleção e recrutamento por ter demonstrado um viés sexista na seleção de candidatos.

O

sistema da big tech foi criado a partir de padrões de currículos recebidos ao longo de dez anos, a maioria de homens. Isso levou a IA a entender que os melhores candidatos para as vagas eram pessoas do sexo masculino, dando notas menores a candidaturas que apresentavam a palavra “mulher”.

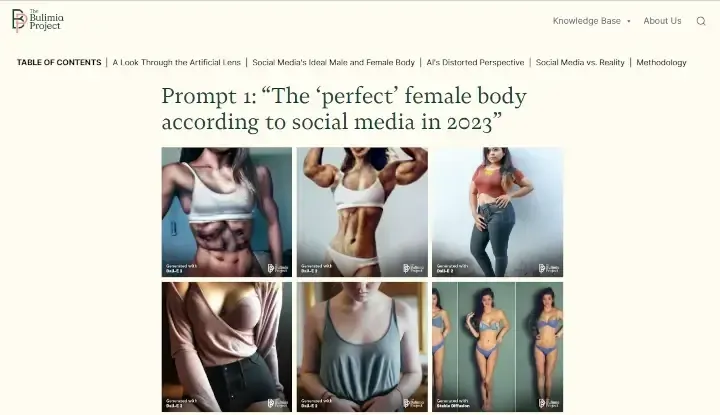

Outro exemplo são as imagens geradas por IA em plataformas como Dall-E 2, Stable Diffusion e Midjourney. Pesquisadores do

The Bulimia Project deram os seguintes comandos a essas ferramentas:

Das imagens geradas que representavam as mulheres, metade tinha a pele branca e 37% tinham corpos musculosos impossíveis de existirem no mundo real. Das masculinas, 63% tinham pele branca.

Além do impacto na saúde mental, o contato com esse tipo de imagem reforça ideologias racistas, capacitistas e gordofóbicas, ao resultar em um único padrão tido como “belo” e “perfeito”.

Quem são os autores de ilustrações, poemas, artigos, músicas e vídeos gerados por inteligência artificial?

Não há uma resposta nem consenso no debate jurídico. Por enquanto, aqui no Brasil, obras criadas por IA generativa não são protegidas por direitos autorais, por isso podem ser usadas livremente sem que ninguém precise ser pago por isso.

À primeira vista, parece algo positivo, não é? Mas você já parou para pensar nos artistas cujas obras alimentaram as bases de dados e treinaram os algoritmos?

Para ferramentas como ChatGPT, Midjourney e DALL-E gerarem conteúdo semelhante ao produzido por humanos, seus algoritmos passam por um treinamento com centenas de milhares de textos, imagens e sons. Todo esse material é encontrado na internet, inclusive

obras protegidas por direitos autorais.

É comum que artistas ou empresas detentoras desses direitos não sejam consultados sobre o uso do material nem remunerados por isso. Essa questão levou o Getty Imagens, um dos maiores bancos de imagens do mundo, a

processar a Stability AI.

A desenvolvedora de IA foi acusada de usar indevidamente mais de 12 milhões de fotos para treinar o sistema de geração de imagens Stable Diffusion AI. No momento em que este artigo estava sendo escrito, a Justiça dos Estados Unidos ainda não havia chegado a uma resolução.

As empresas que desenvolvem sistemas de IA generativa alegam que o uso das obras é mínimo, o que não configuraria uma exploração comercial de um produto final. Mas é preciso considerar que o conteúdo protegido por direitos autorais usado no treinamento de algoritmos leva a um proveito econômico por parte das desenvolvedoras.

Outro ponto que complexifica a discussão é a dificuldade de identificar a fonte exata que foi usada pela IA generativa. Se for identificada, quem responderia pela possível violação de direitos autorais? A pessoa que usou a ferramenta ou a empresa que a desenvolveu?

A coleta e uso de dados sem consentimento também acontece fora do meio artístico. As informações pessoais de usuários de redes sociais, buscadores e ferramentas de IA generativa também podem servir para treinar algoritmos.

Vamos usar a Open AI, a criadora do ChatGPT, e suas

políticas de privacidade como exemplo.

Ela já alimentou a sua base de dados com

300 bilhões de palavras extraídas da internet – o que inclui artigos de blog, reviews de produtos, comentários em sites e publicações nas redes sociais. Todas essas informações foram coletadas e usadas no treinamento do algoritmo sem autorização do usuário.

Mesmo sendo público, esse tipo de conteúdo pode ser usado para ferir a integridade contextual do seu autor. Esse princípio diz que os dados gerados pelos indivíduos não podem ser revelados fora do contexto em que foram originalmente produzidos.

Partindo agora para a criação de uma conta na OpenAI: é possível, sim, o usuário verificar se as suas informações pessoais estão armazenadas e solicitar sua exclusão do banco de dados da empresa. No entanto, é preciso mandar um e-mail para a empresa de IA e aguardar que a solicitação seja atendida.

Lembrando que, no Brasil, a

Lei Geral de Proteção de Dados (LGPD) garante que as pessoas saibam como suas informações são usadas e peçam a retirada delas das bases de dados de empresas.

Criada a conta, hora de usar a ferramenta. Ao aceitar os termos de uso da OpenAI, todo o conteúdo do comando que você der para o ChatGPT será incluído ao banco de dados da empresa. O sistema também poderá coletar o seu endereço de IP, as configurações do seu navegador e as suas atividades de navegação.

Além de serem usados no treinamento de algoritmos, todos esses dados podem ser compartilhados com terceiros não especificados, sem nem ao menos um aviso aos usuários.

Outros serviços de IA generativa têm políticas de privacidade frágeis, porém a da OpenAI ilustra os riscos à privacidade do indivíduo.

A desinformação é a última desvantagem da inteligência artificial da lista.

Hoje é possível que

qualquer pessoa use a IA generativa para criar grandes quantidades de conteúdo falso, de forma rápida, fácil e barata. Podem ser textos, fotos, vídeos e áudios, que são tão semelhantes aos produzidos pelos seres humanos que confundem os nossos sentidos.

Além da criação da informação falsa, a IA permite o desenvolvimento de bots para espalhar a desinformação pelas redes sociais e pelo WhatsApp.

Um exemplo é uma foto falsa de uma

explosão no Pentágono , nos Estados Unidos, em maio de 2023. A imagem foi compartilhada por usuários com contas verificadas no X, então chamado de Twitter, e levou a uma queda no mercado de ações do país.

Alguns caminhos para lidar com esse contexto são: a regulação da IA, a exigência de que todo conteúdo gerado ou manipulado por IA seja rotulado nas redes sociais e a responsabilização das empresas de tecnologia pela disseminação de desinformação.

Os principais riscos da IA são desemprego estrutural, aumento da desigualdade social, perpetuação de vieses e preconceitos, indefinição sobre direitos autorais, ameaças à privacidade e desafios éticos e de segurança.

A IA causa o desemprego estrutural ao automatizar tarefas repetitivas, o que pode levar à substituição de empregos tradicionais, forçando a requalificação em larga escala e gerando tensões no mercado de trabalho.

A IA contribui para a desigualdade social ao aumentar ainda mais a vantagem do capital sobre o trabalho, o que enfraquece instituições laborais – como sindicatos, negociações coletivas e regulamentação governamental.

Com a automação de tarefas, a IA indiretamente impactará a arrecadação de governos via tributos, o que diminui a capacidade do Estado de manter e ampliar programas de redistribuição de renda.

Quando treinada com dados históricos, a IA pode reproduzir discriminação contra grupos minoritários — como aconteceu com um sistema da Amazon que penalizava currículos de mulheres.

Obras usadas para treinar IA não têm direitos garantidos; artistas têm percebido uso indevido de seus conteúdos sem remuneração adequada.

A IA ameaça a privacidade ao armazenar dados e usá-lo em treinamentos de algoritmos sem o consentimento explícito do usuário. Isso pode expor informações fora do contexto original.

Sim. Sistemas podem ser explorados para criar ataques cibernéticos, manipular a opinião pública ou desenvolver tecnologias perigosas sem controle adequado.

Os riscos da IA podem ser mitigados por meio de medidas como transparência (IA explicável), auditorias independentes, diversidade nas equipes de desenvolvimento, regulamentações específicas e monitoramento contínuo.

Por Redação

Gostou deste conteúdo? Compartilhe com seus amigos!

Assine a News da Pós para ficar por dentro das novidades

Receba conteúdos sobre:

Formulário enviado com sucesso!